Por muitos anos, o centro das atenções em inteligência artificial foi a criação dos modelos de linguagem cada vez maiores, com mais parâmetros, dados e capacidades. Bilhões foram investidos globalmente nessa corrida. Agora, estamos em uma nova etapa: como afirmou Itai Asseo, da Salesforce, a verdadeira inovação nasce na combinação desses modelos com sistemas bem desenhados ao seu redor.

Nesse novo cenário, os LLMs são apenas o motor, precisamos do restante do veículo: memória, raciocínio, ação e percepção.

O que mudou no jogo dos LLMs?

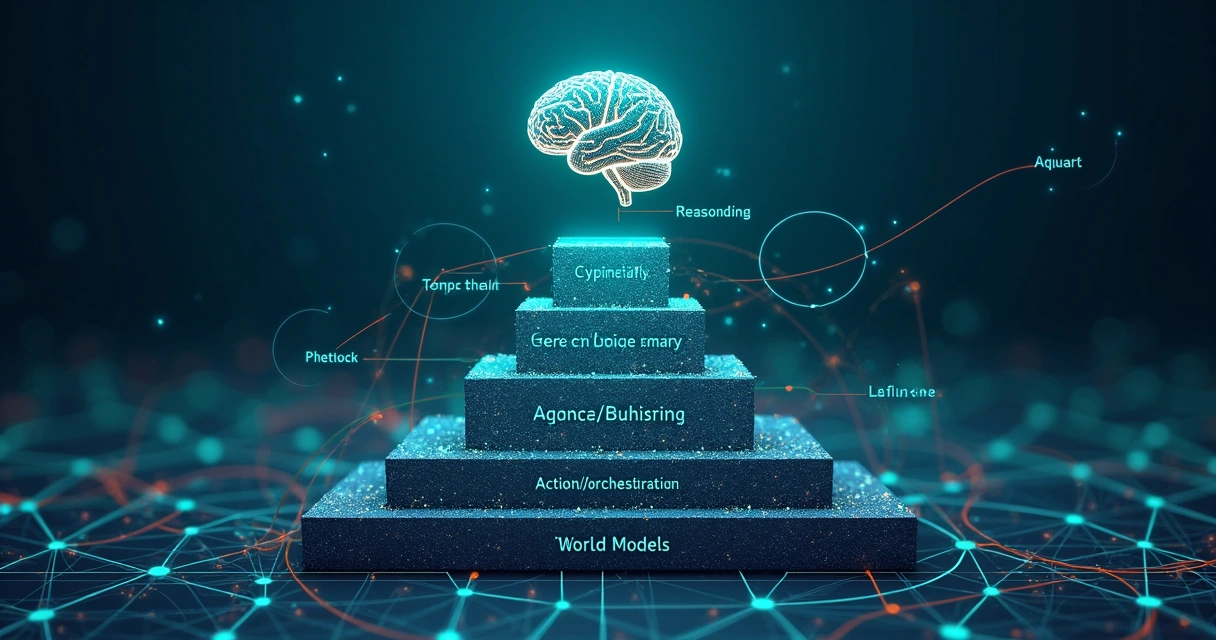

A comunidade acadêmica e corporativa percebeu: os LLMs tornaram-se infraestrutura comum. Não há mais segredo em “construir o maior modelo”, já que os principais algoritmos estão disponíveis e disseminados. O que diferencia uma empresa de outra está na capacidade de criar sistemas completos e conectados, usando as quatro grandes camadas dos novos sistemas de IA, como mostrado por pesquisadores no evento da Escola de Primavera de LLMs da USP, e também amplamente aplicado por plataformas inovadoras, como a SprintHub.

O segredo não está no tamanho do modelo, mas no sistema que o cerca.

Os quatro pilares que constroem sistemas de IA de verdade

Ao analisarmos os avanços práticos, identificamos quatro componentes principais que transformam o potencial dos LLMs em valor real para os negócios.

1. Memória de longo prazo

1. Memória de longo prazo

Sem memória, toda conversa recomeça do zero. Para manter o contexto, seja em vendas ou atendimento, é preciso armazenar interações anteriores e aprender com elas. Metodologias como a extração por blocos, estudadas e aplicadas por especialistas como William Dressler e Silvio Savarese, permitem que a IA lembre detalhes importantes, como preferências dos clientes ou histórico de negociações —, eliminando a sensação de robô esquecido. No SprintHub, já usamos memória contextual para criar jornadas omnichannel realmente integradas, fazendo com que o lead nunca precise se repetir.

2. Raciocínio e planejamento

Responder dúvidas simples não basta. Grandes nomes como Marc Benioff defendem sistemas capazes de raciocinar em múltiplos passos, criando planos como faria uma equipe humana. Essa etapa é essencial, por exemplo, para montar propostas de vendas personalizadas ou desenhar campanhas de marketing automáticas. Engine de raciocínio, como o Atlas Reasoning Engine, tira os LLMs do campo da “resposta rápida” e coloca-os como assistentes estratégicos.

3. Ações e orquestração

O grande salto acontece quando a IA não só sugere, mas executa tarefas: consultar dados, atualizar cadastros, acionar fluxos ou mesmo negociar entre empresas. Essas camadas de ação e orquestração tornam-se especialmente poderosas quando podem operar entre times e sistemas diferentes, como já ocorre em algumas implementações de agentes conectados pela SprintHub. Uma arquitetura bem coordenada faz com que o assistente não apenas fale, mas realmente trabalhe.

4. Modelos de mundo (world models)

A fronteira mais interessante, apontada por Fei-Fei Li, são os modelos que simulam e entendem não só linguagem, mas interações físicas e contextuais. Imagine agentes que preveem impactos de uma decisão levando em conta logística, clima, legislação e tendências do mercado. Aqui, a IA começa a “sentir” o ambiente, dando um próximo passo gigantesco em automação inteligente.

Devo sempre buscar o LLM mais avançado?

Essa é a grande armadilha do momento: acreditar que só o modelo de linguagem resolve tudo. No nosso trabalho, percebemos que construir uma solução eficaz começa pelo desafio do negócio: atendimento que exige memória, relatórios que dependem de raciocínio, processos internos que precisam de ação coordenada, cada caso pede um arranjo diferente dessas quatro camadas.

- Atendimento ao cliente omnichannel? Memória contextual é o coração.

- Geração de propostas complexas? Raciocínio encadeado faz a diferença.

- Automação entre setores? Orquestração de agentes é prioridade.

- Análise preditiva de cenários de mercado? Modelos de mundo trazem precisão.

A plataforma SprintHub surgiu para ajudar empresas a não dependerem de uma única “ferramenta mágica”. Nosso compromisso é integrar todas as camadas de IA em soluções modulares, sempre baseadas na necessidade concreta do negócio, de captação de leads a automação de processos complexos.

Impacto cultural e governança: o verdadeiro desafio

Os discursos de especialistas como Fei-Fei Li e Marc Benioff reforçam: a maior transformação é a cultural, não apenas tecnológica. Empresas precisarão alinhar equipes, processos e governança para explorar IA como um “parceiro de equipe” que aprende, planeja e executa.

Não basta integrar recursos: é preciso repensar fluxos, cuidar da segurança e garantir que humanos e máquinas caminhem juntos, como detalhamos em discussões sobre transformação cultural em IA.

Criando sistemas completos: o que já dominamos e o que falta aprender

Já estamos habituados com engenharia de prompts e design de fluxos conversacionais, grandes habilidades. Mas o desafio agora é expandir horizontes criando sistemas completos: agentes inteligentes, chatbots sofisticados, pipelines de automação e integração entre setores (mais sobre automação). Um bom começo é o nosso guia de chatbots para vendas B2B.

A vitória não está no modelo, mas na solução que transforma realidades.

Conclusão: Hora de sair do hype dos modelos e ativar sistemas inteligentes

Em nossa experiência e segundo especialistas renomados, como Fei-Fei Li, os LLMs já atingiram maturidade e se consolidaram como infraestrutura digital. O diferencial real está em saber combinar memória, raciocínio, ação e modelos de mundo, criando soluções que mudam a rotina do negócio, como já fazemos na SprintHub.

Se sua empresa busca integrar IA de verdade, não siga apenas o modelo do hype, mas escolha a arquitetura certa para seu desafio. Fale com nosso time, experimente nossos produtos e avance na criação de sistemas que realmente fazem a diferença.

Perguntas frequentes sobre LLMs e novos sistemas de IA

O que são LLMs como infraestrutura?

LLMs como infraestrutura são grandes modelos de linguagem que funcionam como base para diversos sistemas e aplicações de IA, deixando de ser diferencial exclusivo e tornando-se componentes comuns sobre os quais outras soluções inovadoras podem ser construídas.

Quais os 4 pilares dos novos sistemas de IA?

Os quatro pilares são: memória de longo prazo (manter histórico e contexto), raciocínio e planejamento (criar respostas em múltiplos passos), ações e orquestração (executar tarefas práticas em sistemas reais), e modelos de mundo (simular e entender ambientes físicos e contextuais).

Como funcionam os LLMs em sistemas de IA?

Os LLMs processam e geram linguagem natural, mas só entregam todo seu valor quando integrados a sistemas que proporcionam memória, raciocínio, capacidade de agir e de simular cenários, tornando possíveis soluções mais inteligentes e personalizadas.

Vale a pena implementar LLMs na empresa?

Vale a pena quando a adoção parte do problema real do negócio e envolve a combinação ideal de componentes. LLMs por si só são poderosos, mas se tornam muito mais úteis quando usados com sistemas que resolvem desafios específicos da empresa.

Quais as vantagens dos LLMs como infraestrutura?

Ao tratar LLMs como infraestrutura, empresas ganham flexibilidade para criar soluções sob medida, aumentam a velocidade de inovação e conseguem resultados mais integrados entre áreas como vendas, atendimento e marketing. Combinando os quatro pilares, é possível construir sistemas realmente transformadores.